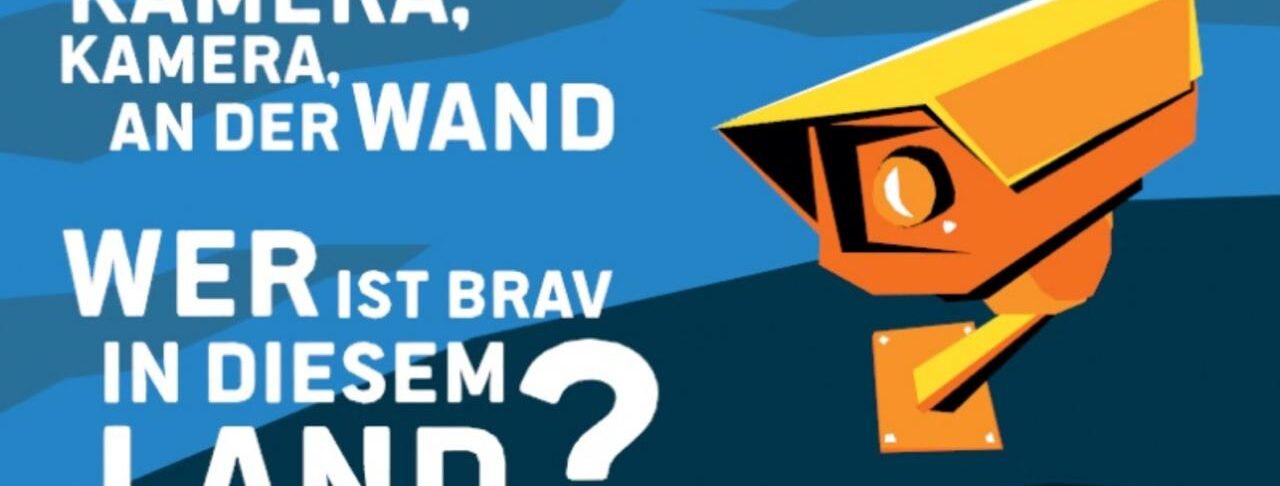

Das Rote Rathaus ist das Herz der Berliner Demokratie – und genau dort soll nun KI-gestützte Videoüberwachung mit Verhaltensanalyse getestet werden. Laut rbb und Berliner Morgenpost werden alle erfassten Informationen anonymisiert bleiben. Biometrische Daten und Identitäten von Menschen würden nicht erfasst – das sei mit der Datenschutzbeauftragten abgestimmt.

Die Piratenpartei Berlin nimmt diese Zusicherung ernst – und bleibt dennoch strikt dagegen. Denn „anonymisiert“ heißt nicht „harmlos“. Selbst ohne direkte Gesichtserkennung oder Namenszuordnung entsteht durch KI-Verhaltensanalyse ein massives Grundrechtsproblem:

Anlasslose Massenüberwachung bleibt bestehen:

Jede vorbeilaufende Person wird automatisch auf „auffälliges Verhalten“ gescannt – ob Tourist:in, Demonstrant:in oder Radfahrer:in. Anonymisierung ändert nichts daran, dass der Staat Verhalten von Unschuldigen prädiktiv bewertet.

KI-Fehler und Bias wirken weiter:

Algorithmen für „abnormales Verhalten“ haben bekannte hohe Fehlerraten – besonders bei Minderheiten, queeren Personen oder Menschen mit Behinderungen. Racial Profiling und Diskriminierung passieren nicht erst bei der Identifizierung, sondern schon bei der Verhaltensklassifizierung.

Schleichende Ausweitung wird erleichtert:

Was heute „nur“ vor dem Roten Rathaus als Test läuft, wird morgen Standard an allen sensiblen Orten. Die Behauptung „keine biometrischen Daten“ ist kein Freibrief für eine Blackbox, die Verhaltensprofile erstellt.

Darüber hinaus bleiben auch bei anonymisierten Daten Algorithmen, Trainingsdaten und Alarmkriterien intransparent. Weder Parlament noch Datenschutzbeauftragte haben vollen Zugriff – und „abgestimmt“ heißt nicht „genehmigt ohne Bedenken“.

Auch die Versammlungsfreiheit wird damit indirekt angegriffen:

Wer weiß, dass sein Verhalten vor dem Sitz der Landesregierung von KI bewertet wird, überlegt sich zweimal, ob er demonstriert, Flugblätter verteilt oder einfach nur länger stehen bleibt.

Ein demokratischer Rechtsstaat schützt seine Institutionen durch klare, verhältnismäßige und gerichtlich überprüfbare Maßnahmen – nicht durch vorauseilende Algorithmus-Überwachung, die selbst bei Anonymisierung die informationelle Selbstbestimmung aushöhlt.

Wir fordern daher weiterhin:

Keine KI-Verhaltensanalyse im öffentlichen Raum.

Keine Tests vor dem Roten Rathaus oder sonstwo.

Kein Smart-City-Überwachungspaket auf Vorrat.

Datenschutz ist Demokratie – auch wenn die Daten „anonymisiert“ daherkommen.